在讨论SEO与GEO有什么”区别”之前,我们需要先回答一个更基本的问题:

AI引用你的内容之前,需要经过哪些步骤?

答案是:抓取 → 索引 → 检索 → 排序 → 被引用。

这个链条上的每一步,都依赖传统搜索引擎的基础设施。如果你在任何一步失败了,后面的”被AI引用”根本不存在。

这不是理论推演。这是系统运行的事实。

第一,抓取:LLM没有独立的抓取体系

ChatGPT Search用的是Bing的索引(Barry Schwartz, Search Engine Roundtable, 2024年11月确认)。OpenAI VP of Engineering在AMA中证实Bing是ChatGPT搜索功能的重要组成部分。

Perplexity同样依赖Bing和Google的API进行实时检索。Perplexity创始团队明确表示,当用户提问时,系统会将查询发送到传统搜索引擎的API来获取结果(HyperLinker, 2025年3月)。虽然Perplexity有自己的爬虫PerplexityBot,但其自建索引规模远不及Google和Bing,Perplexity团队自己承认他们目前专注于”头部分布”,即最受欢迎和最高质量的内容。

Google AI Overview用的是Google自己的索引。

ChatGPT确实有OAI-SearchBot爬虫,但大量主流网站已经在robots.txt中屏蔽了AI爬虫。而且即便OAI-SearchBot抓到了页面,ChatGPT Search的实时搜索仍然依赖Bing的索引来检索结果。

结论:AI系统的内容来源,就是传统搜索引擎的抓取和索引基础设施。没有Google和Bing,LLM无法”看到”互联网上的绝大部分内容。

第二,索引:没有任何LLM有独立索引

这是最致命的一点。

索引是什么?Google官方文档说得很清楚:

“Google Search works in three stages… Indexing: Google analyzes the text, images, and video files on the page, and stores the information in the Google index, which is a large database.” — Google Search Central, How Search Works

Google的索引覆盖了”数千亿网页,大小超过100,000,000 GB”(Google, How Search Works)。

Bing的索引大约覆盖120亿网页。

没有任何一个LLM拥有这种规模的独立索引。

ChatGPT Search依赖Bing索引——如果一个页面不在Bing的索引中,它就不会出现在ChatGPT的搜索结果中(Search Engine Land, 2024年11月)。

Perplexity依赖Google和Bing的API——它不是在搜索自己的索引,而是在向Google请求最相关网页的列表(Primary Position, 2026年3月)。

Google AI Overview使用Google自己的索引。

索引是检索的前提。你不在索引里,就不可能被检索到。你不可能被检索到,就不可能被引用。

所以,当GEO从业者告诉你”优化AI引用”的时候,问他们一个问题:你的内容连索引都没进,优化什么?

第三,检索:不是GEO的发明,是IR的基础操作

GEO从业者声称GEO的检索单位是”chunk”、”passage”、”可引用的事实”,好像这是某种新的技术突破。

这不是。

Google在2020年10月宣布了Passage Ranking,2021年2月在美国上线。Google的原话是:

“We’ve recently made a breakthrough in ranking and are now able to not just index web pages, but individual passages from the pages. By better understanding the relevancy of specific passages, not just the overall page, we can find that needle-in-a-haystack information you’re looking for.” — Google, 2020年10月

注意两件事:

第一,Google明确说这不是索引变化,而是排名变化。Google仍然索引整个页面,只是在排名时可以独立评估页面内的段落。Google的Martin Splitt被问到SEO是否需要为此做任何调整时,他摇头说”不需要”。

第二,Passage retrieval、document chunking、tokenization——这些是信息检索(Information Retrieval)领域几十年前就有的基本概念。任何读过IR入门教材的人都知道这不是新东西。BM25算法、倒排索引、TF-IDF——这些是1970年代就存在的技术。

Perplexity的创始人Aravind自己也谈过传统IR方法的价值,包括BM25算法和domain authority信号。

如果你想理解”AI搜索”背后真正在发生什么,去读Google官方的”How Search Works”文档,去读一本IR教材,理解什么叫tokenization和倒排索引。不要从GEO营销文案里学搜索技术。

第四,没有任何工具能准确衡量”AI可见性”

GEO从业者推出了一系列新指标:AI Visibility、Citation Rate、Share of Voice、AI Mention Rate。

问题是:没有任何一个工具能准确衡量这些指标。

原因很简单:

- ChatGPT没有公开的citation API,你无法系统性地追踪你被引用了多少次

- Perplexity没有类似GSC的工具让你查看被引用数据

- AI回复是动态生成的,同一个问题在不同时间、不同用户那里可能得到完全不同的答案和引用源

- 70.6%的AI流量到达时没有referrer headers,在标准分析工具中完全不可见(The Digital Bloom, 2026年2月)

你无法准确衡量的东西,你怎么优化?你怎么证明你的”GEO优化”有效?你怎么向客户交代ROI?

对比一下SEO:GSC给你精确的展示、点击、CTR、排名数据。Ahrefs给你关键词排名、外链数据。Google Analytics给你流量和转化数据。每一步都是可衡量、可验证的。

一个不可衡量的学科不是学科,是信仰。

第五,AI的受众还是人类

GEO从业者说”SEO面向人类用户,GEO面向AI系统”。

但AI系统不是终端用户。人才是。

AI只是一个中间层——它从搜索索引里取内容,整理后呈现给人。你优化的终点还是人类,路径还是通过搜索索引。

说”优化给AI看”就像说”我要优化给谷歌看”——谷歌也不是你的受众,谷歌背后的搜索者才是。AI也一样。

这不是区别,这是换了个说法。

第六,流量数据:GEO是在为0.15%的流量建一个独立学科

AI平台贡献的全球流量份额:0.15%–0.25%(Similarweb, 2026年1月)。

有机搜索的全球流量份额:48.5%。

Google发送的流量是所有AI平台加起来的300倍以上。

AI搜索referral流量在2026年3月达到0.9%(Similarweb Gen AI Tracker),同比增长了5倍——但基数极小。

GEO从业者会说”但AI流量的转化率更高”。数据确实显示AI流量在某些垂直领域转化率更高。但基数太小了——你为一个占全球流量不到1%的渠道单独建一套优化体系、指标体系、收费体系?

更重要的是:被AI引用的内容,绝大多数本身就在Google排名靠前。Seer Interactive的研究发现87%的SearchGPT citations与Bing Top Results匹配(Seer Interactive, 2025年2月)。

你做好SEO,AI引用自然就来了。你SEO没做好,搞什么GEO都不会被引用。

逐条击破:行业声称的”SEO vs GEO区别”

“SEO追求排名,GEO追求被引用”

被引用的前提是你先排上去。数据已经证明被ChatGPT引用的页面绑定在Bing的Top Results上。引用是排名的结果,不是独立的优化目标。

“SEO的单位是页面,GEO的单位是可引用的事实/chunk”

Google 2020年就做了Passage Ranking,这不是GEO发明的。而且passage能不能被检索到,取决的还是页面的权威度和相关性,不是你把句子写得多”self-contained”。

“GEO需要Schema、结构化数据、named experts”

2026年5月9日,Google官方宣布不再支持FAQ rich results。David Quaid用一个3个月的域名、没有任何Schema,拿到了18,000个SERP features。Schema不影响排名,E-E-A-T不是排名因素。这些是换了GEO包装的老说法。

“GEO有独立的指标体系:AI Visibility、Citation Rate”

没有任何工具能准确衡量这些指标。70.6%的AI流量没有referrer headers。不可衡量的指标不是指标。

“GEO面向AI系统,SEO面向人类”

AI不是终端用户,人才是。AI从搜索索引取内容呈现给人,跟搜索引擎做的事情一模一样。

“GEO是零点击,获取mind share”

不可衡量的”mind share”不是商业价值。你告诉客户”虽然没人来你网站,但AI提到你了”——这句话能收到钱吗?

“AI喜欢新鲜内容,所以要持续更新”

AI时代每天产出的内容量是以前的几十上百倍。如果”新鲜”真的是AI引用的关键因素,那这些海量新内容应该排名很好、被大量引用才对。现实是什么?绝大部分新内容连Google的索引都进不了。

所谓Freshness只在特定query类型上有效——新闻、赛事、突发事件这种有明确时效性需求的查询。对于绝大部分evergreen query来说,发布日期不是排名因素,更不是AI引用的决定因素。一篇2019年的文章如果有足够的Authority和Relevance,照样排在今天新发的文章前面,照样被AI引用。

“保持内容新鲜度”这个建议的本质是什么?是给内容代运营服务找续费理由——你不持续付钱让我写新内容,Google/AI就不喜欢你了。

“页面速度影响AI引用(499错误码)”

Mike King(iPullRank)最近发了一篇文章声称499响应码导致AI系统无法获取你的页面,影响”AI可见性”。他的解决方案包括Edge Caching、为AI bot设置专门的Cloudflare缓存规则、给AI bot提供Markdown版本的页面。

这篇文章的问题在于:它把一个基础的服务器性能问题包装成了”AI Search特有的新挑战”。499不是AI搜索的问题,是你服务器的问题。如果你的服务器慢到连AI bot都等不及断开连接,那Googlebot、普通用户也一样会遇到问题。修好你的服务器性能、做好CDN配置,这是基本的运维工作,不是什么”AI Search Strategy”。

而且他的文章最终落脚点是什么?”Read About Our AI Search Strategy” → 卖他的AI Search Strategy Program。

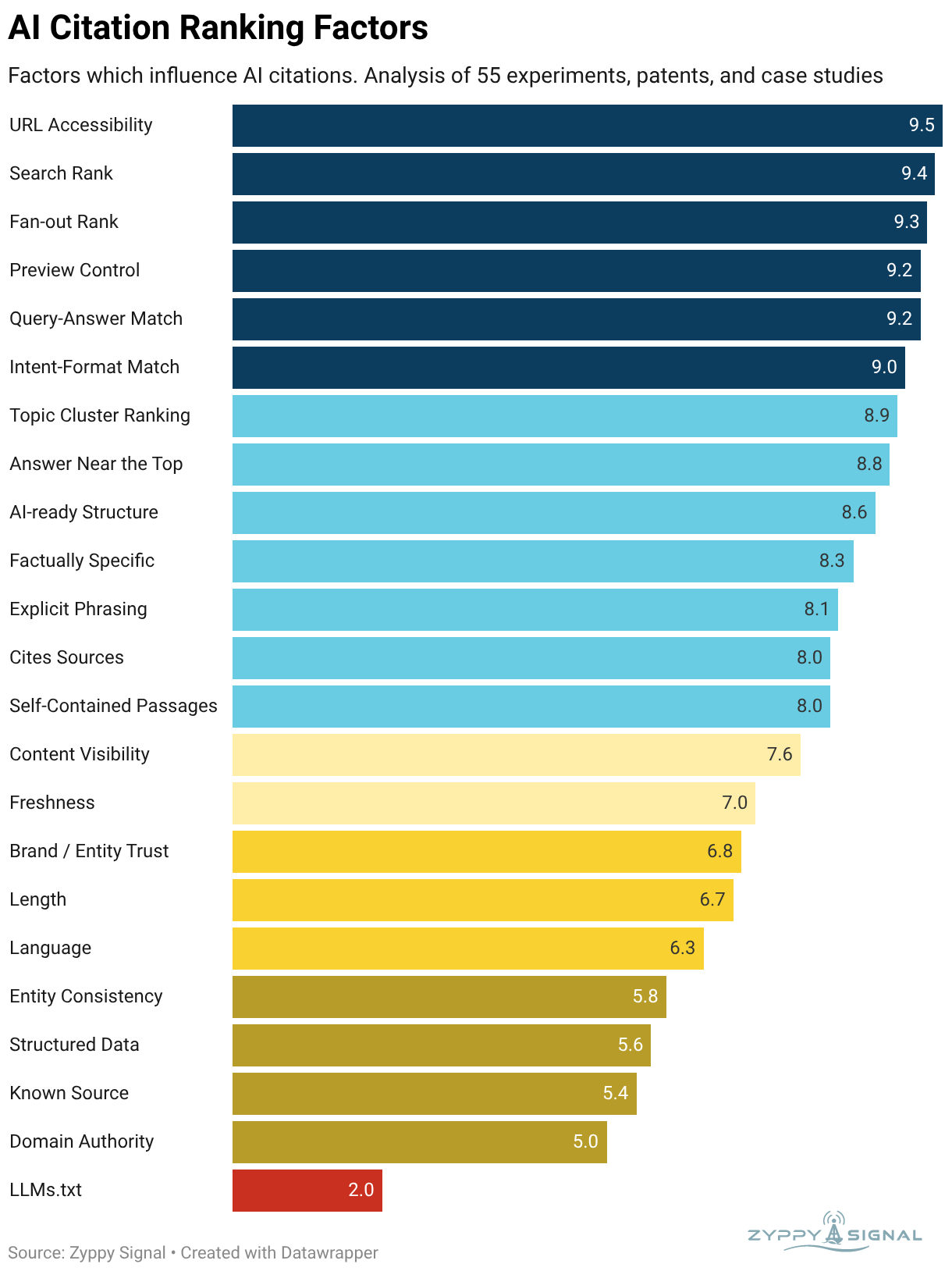

Zyppy Signal的”22个AI Citation排名因素”

排在最前面的URL Accessibility(9.5)和Search Rank(9.4)——这两个本质上就是”你的页面能不能打开”和”你在搜索引擎排第几”。这是SEO的基本功,不是什么AI Citation的独特因素。

中间那一堆——Query-Answer Match、Intent-Format Match、Topic Cluster Ranking、Answer Near the Top、AI-ready Structure、Factually Specific、Explicit Phrasing、Self-Contained Passages——这些全是在描述”写好内容”。你的内容回答了用户的问题、结构清晰、事实准确——这不是任何新发现,这是写作的基本要求。给它们起个”AI-ready”的名字不会让它们变成新东西。

排在后面的Structured Data(5.6)、Domain Authority(5.0)、LLMs.txt(2.0)——他们自己的数据已经在说这些东西不重要了,但GEO行业还在拼命推这些。

最核心的问题是:这个图表声称基于”55 experiments, patents, and case studies”,但把不同来源、不同方法论的研究混在一起打分,然后排成一个好看的柱状图——这不是meta-analysis,这是拼凑。每个”因素”的评分标准是什么?权重怎么算的?不同研究之间的方法论差异怎么处理的?都没有。

说到底,这22个因素拆开来只有两件事真正重要:你的页面能被访问到(URL Accessibility = 抓取/索引),你在搜索引擎排得上去(Search Rank = Authority × Relevance)。其他20个要么是”写好内容”的不同说法,要么是根本不重要的东西。

这就是SEO。

他们自己的数据在替我们说话——影响AI引用的最重要因素,就是传统SEO的核心指标。

结论

GEO声称自己是一个独立于SEO的新学科。但:

- 它没有独立的抓取体系——依赖Google和Bing的爬虫

- 它没有独立的索引——完全寄生在Google和Bing的索引上

- 它的”检索创新”——是IR领域几十年前就有的基础技术

- 它的指标——不可准确衡量

- 它的受众——还是人类

- 它的流量——占全球不到1%

GEO不是一个学科,是一个营销概念。

它的运作模式是:把SEO的基础设施、IR的基础概念、E-E-A-T和Schema的旧话术重新包装,告诉你”这是新东西,你需要新的优化策略,你需要请新的专家”。

然后收你两份钱。

事实很简单:做好SEO——抓取、索引、内容质量、外链权威——AI引用自然就有了。

不需要新学科。不需要新工具。不需要交智商税。

独立Google SEO专家,ylsseo.com创始人,基于Google专利、IR与API Leak解读排名机制,中文SEO启蒙第一人。