如果你做过谷歌SEO,大概率写过或者见过这类文章:”Best CNC Machine Manufacturers 2026″、”Top 10 SEO Agencies in China”、”Best Standing Desks for Home Office”。

这类文章有一个共同特征:作者把自己或者自己的品牌列进去,通常还排在前几名。

以前这招确实好用。Listicle格式天然适合排名,竞争低的长尾词随便写都能上首页。写完一篇不仅有流量,还给自己打了广告,同时多平台发布还能刷AI搜索的可见性。成本几乎为零,一石三鸟。

但到了2026年,这条路正在收窄。不是因为Google讨厌listicle这个格式,而是因为更深层的信任逻辑正在发生变化。

先说清楚一点:不是所有”best X”内容都死了。 Wirecutter有真实的测评团队和可验证的测试方法论,CNET有独立的评测流程,这类内容到现在依然排得很好,在AI引用里的表现甚至更好。真正被打击的是自荐式、低质量、规模化的那一套——自己写、自己排第一、批量铺、没有任何真实依据。

Google正在亲自做中间商

你现在去搜任何一个”best X”类的查询,看看搜索结果页长什么样。

顶部是Shopping Ads,紧接着是AI Overview直接推荐产品,再往下是Google Shopping的产品轮播。传统的organic蓝链被挤到了第二屏甚至更下面。

Google不是在打击”best X”内容。Google是在把这个环节的利润收归自己。

以前的链条是:用户搜”best X” → 点进某个listicle页面 → 通过推荐链接去购买或发询盘 → 页面作者赚到了曝光或佣金。现在Google想做的是:用户搜”best X” → Google直接展示产品和广告 → 用户在Google生态内完成决策 → Google赚广告费。

中间商从你变成了Google自己。

从Google的角度,这叫”减少一次跳转等于更好的体验”。从内容创作者的角度,这叫流量被截胡了。Shopping Ads推的产品是竞价排序的,不是按用户需求匹配的。一堆产品摆在你面前,你还是不知道哪个适合自己。用户体验有没有真正变好,这个见仁见智,但organic的空间确实被大幅压缩了。

自己说自己好,三个系统都不信了

不管是搜索引擎、Knowledge Graph还是LLM,底层都在回答同一个问题:这个推荐是第三方背书,还是自我声明?

你自己写一篇”Best SEO Agencies”然后把自己排第一,这不是推荐,这是广告。以前Google的算法还没聪明到能分辨这个区别,现在越来越能了。LLM就更直接——它在判断引用谁的时候,会看这个信息是不是在多个独立来源中被一致提及。你自己写的文章夸自己,只算一个来源,而且是最不可信的那个。

这跟外链的逻辑一模一样。Editorial link——别人主动引用你——有价值。Self-created link——你自己去别人评论区留的——没价值。同样的道理,别人在他的内容里list你,是真实的推荐信号;你自己写篇文章把自己list进去,信号权重趋近于零。

但”趋近于零”其实还不是最坏的情况。真正危险的是负面信号。

LLM的引用机制不是”提到你就加分”。它有一个置信度判断的过程。当LLM处理你的内容时,它会拿你说的东西跟训练数据和RAG检索到的其他来源做交叉验证。如果验证结果一致,置信度高,你被引用的概率就大。

但如果验证结果矛盾呢?你说自己是行业第一,但没有任何其他独立来源支持这个说法。你的产品排序跟行业里其他人的共识完全不一致。这时候LLM不会简单地忽略你——它会对你这个来源降低信任评分。

这就是很少有人意识到的一个点:如果机器不能自信地认为你是对的,那你发送的就不是零信号,而是负面信号。

类比一下:你去面试,不说话最多是没印象。但你张口吹了一个很容易查证的牛,面试官一查发现是假的,你直接被拉黑了。沉默是零分,撒谎是负分。

所以写”best X”不是不可以,但你要问自己一个问题:LLM拿你这篇文章去跟其他来源交叉验证的时候,你经得起查吗?如果你推荐的东西跟行业共识一致,你有真实的使用经验或测试数据支撑,那这篇内容就是有价值的。如果你只是为了给自己打广告随便排了个序,那你不是在积累信号,你是在主动告诉机器:这个来源不靠谱。

“让别人提你”也不是什么干净的事

说到这里可能有人会想:那我不自己写,我去想办法让别人把我列进他们的榜单里。

这条路当然存在,但你得想清楚它通向哪里。

你看到一个”Best X”的榜单排在Google首页,你联系作者或站长,问一句:”If I give you $20,000, can I be ranked number one on your list?” 这种事情每天都在发生。

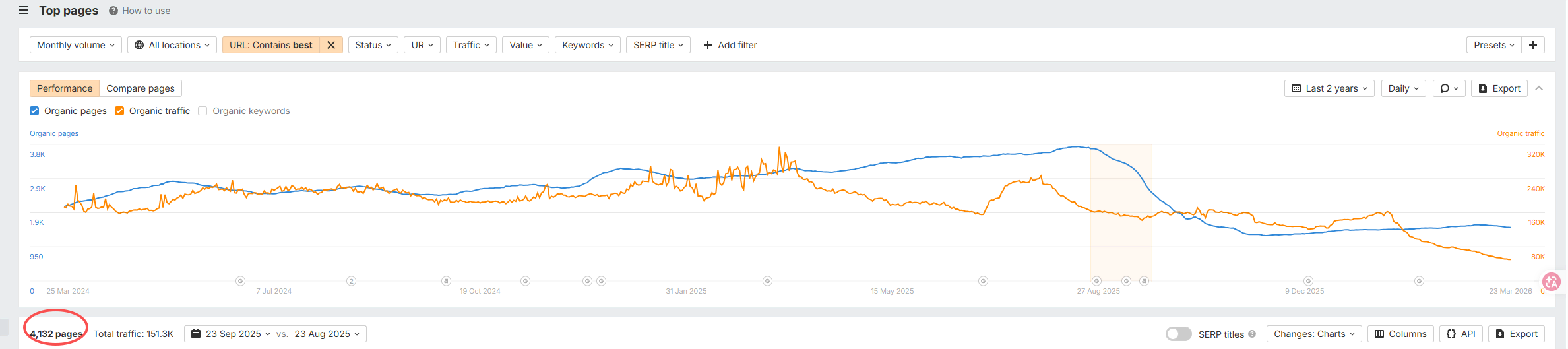

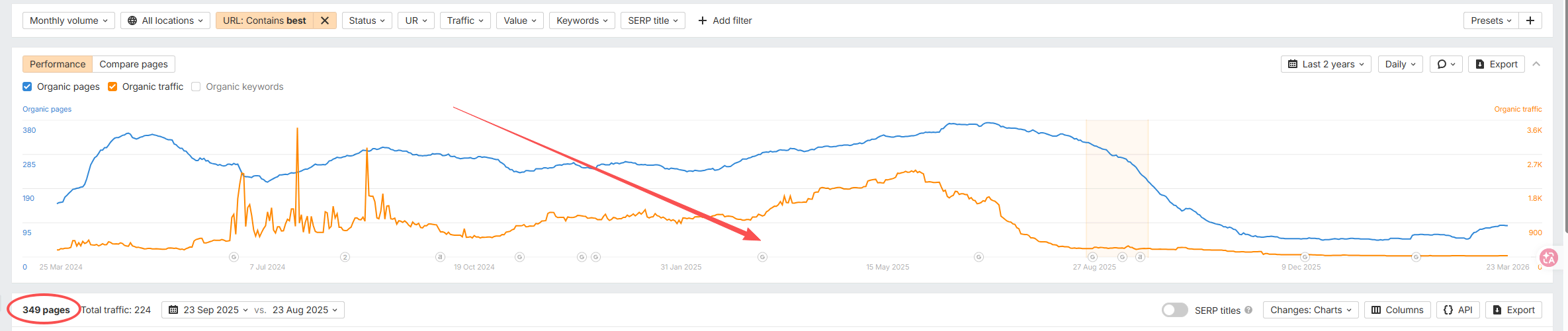

Forbes Marketplace就是这个模式的极端版本。一个DR95的域名,靠发布各种”Best X”listicle内容,据Lars Lofgren的调查分析,年收入在3到4亿美元之间。Forbes Marketplace跟Forbes本身是两家公司,Marketplace利用Forbes的域名权威度发布大量赞助和affiliate内容,排名碾压所有独立站。他还发现CNN和USA Today上也有类似的寄生SEO操作。

而且越来越多类似的操作在涌现。一些高权威站点开放了付费榜单位置,你交钱就能排进去。短期看起来跟真实推荐没什么区别,但本质是声誉滥用(Site Reputation Abuse)。Google从2024年3月开始正式把这个列为违规行为,并在2024年11月更新了政策,明确声明即使有第一方参与监督,利用高权威域名发布第三方内容以操纵排名仍然违规。Forbes Advisor、CNN Underscored、WSJ Buyside等子站已经受到manual action打击,部分内容被直接deindex。

但这也带来了一个问题:当榜单可以买、推荐可以花钱获得的时候,”best X”这个品类的整体信任度就在下降。不是某一篇文章的问题,是整个内容形式的公信力在被透支。用户不信了,Google不信了,LLM交叉验证的时候也会越来越谨慎。

所以”让别人提你”也分两种:一种是你的东西确实好,别人用过之后自然愿意推荐;另一种是你买了一个位置。前者是品牌建设,后者是广告投放。两者在短期内可能看起来效果一样,但在信任验证越来越严格的趋势下,后者的生命周期会越来越短。

E-E-A-T是理想,Entity才是现实

很多顶级专家对E-E-A-T这个概念很反感。

Google说要看Experience、Expertise、Authoritativeness、Trustworthiness。但实际上,Google的算法根本无法验证一个作者简介是真是假。你随便编一个”Dr. John Smith, 15 years of industry experience”,配张AI生成的头像,Google分辨不出来。虚拟作者、假专家简介到处都是,照样排名。

E-E-A-T是Google的愿景,不是算法的执行方式。它是写给Quality Raters看的评估指南,间接影响算法调优的方向,但从来没有一个叫”E-E-A-T score”的排名因子直接参与排序。

真正决定排名的,还是那几个Google能实际量化的东西:域名权威度、外链质量、品牌搜索量、用户行为信号。说白了就是big brand、huge domain、big authority。

那有没有办法真正让Google”确认”一个实体是谁?有的,就是Entity建设。

Jason Barnard在2024年提出了Algorithmic Trinity框架:Search Engines、Knowledge Graphs、LLM Chatbots三位一体。三者的底层数据源都是web,区别在于处理方式。搜索引擎爬取web建索引做排序,核心是”哪个页面最值得排在前面”。Knowledge Graph从web中抽取实体和关系做结构化存储,核心是”这个实体是什么、跟谁有关系”。LLM用web数据训练加RAG实时检索做生成式回答,核心是”综合理解后给出最佳答案”。

但支撑这个框架的不是某一个动作,是一整套证据链:多平台profile的NAP一致性、Schema标记让机器可读、PR分发提供第三方背书、行业目录和评价平台的交叉验证、权威站的editorial mention。这些信号单独拿出来每一个都不够,串在一起才构成Google和LLM判断”这个实体是真实的、可信的、值得建档的”的完整依据。

Entity建设才是E-E-A-T的实际实现路径。写一个好看的作者简介不是。

Rank and Tank

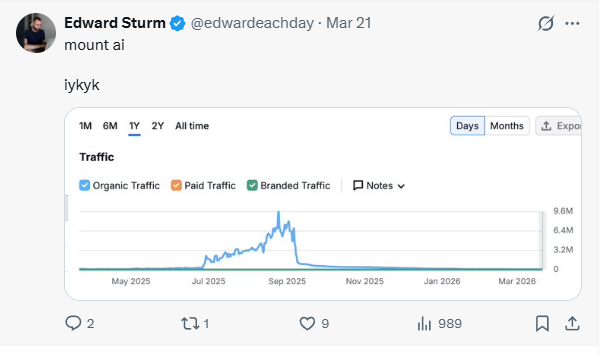

Edward Sturm最近在X上发了一张流量图,配了两个字:”mount ai”。

图上是一个网站的流量曲线——从接近零暴涨到接近一千万,然后断崖式跌回原点。靠AI批量生成的内容冲上去,然后在Core Update里被清洗干净。很多人管这种现象叫”rank and tank”。

这不是个案。同一套打法在大量网站上重复上演:AI批量产出”best X”内容,多平台发布制造跨源共现,短期流量暴涨,然后崩盘。周而复始。

为什么?因为这些内容没有信任基础。Google的算法在进化,LLM的引用机制也在进化,但底层逻辑从来没变过:这个来源能不能被其他来源替代?

如果你的”best X”文章里的信息,换一个AI花三分钟就能生成一模一样的版本,那这篇文章就没有存在的必要。不管是Google还是LLM,都没有理由给它分配流量。

不只是”Best X”:任何可识别的Pattern都在失效

把视野拉远一点。Google和LLM打击的从来不是某一种具体的内容形式,而是可被识别的规模化模式(pattern)。

“Best X”自荐listicle只是其中一种pattern。任何被大规模复制的SEO操作——不管它本身看起来多”白帽”——一旦形成可识别的指纹特征,信号价值就会衰减,严重的直接触发惩罚。

举几个正在发生的例子。

TL;DR摘要。以前在文章开头加一段TL;DR确实对排名和AI引用有帮助,因为它给机器提供了一个结构化的核心摘要。但当所有SEO文章都在开头放一段格式一模一样的TL;DR的时候,它就不再是”优质内容的特征”,而变成了”这篇文章是为SEO写的”的识别标记。信号价值归零。

FAQ Schema批量铺设。每篇文章底部固定放五个FAQ,用插件一键生成,全站几百篇文章都是同一个模板。单篇看没问题,但当Google发现你全站的FAQ模式高度一致、内容高度模板化,它就会判定这不是为了帮用户解答问题,而是为了抢Featured Snippet的SEO手段。

千篇一律的文章结构。”What is X → Why is X important → How to do X → Best practices for X → Conclusion”——这个三段式/五段式结构被AI写作工具批量套用之后,已经变成了低质量内容的指纹。不是说这个结构本身有问题,而是当几百万篇文章用同一个模板的时候,它就是一个pattern。

底层逻辑很简单:当一个操作从”少数人的优势”变成”所有人的标配”时,它就不再是信号,而变成了噪音。 Google和LLM都在做同一件事——识别噪音,过滤掉。

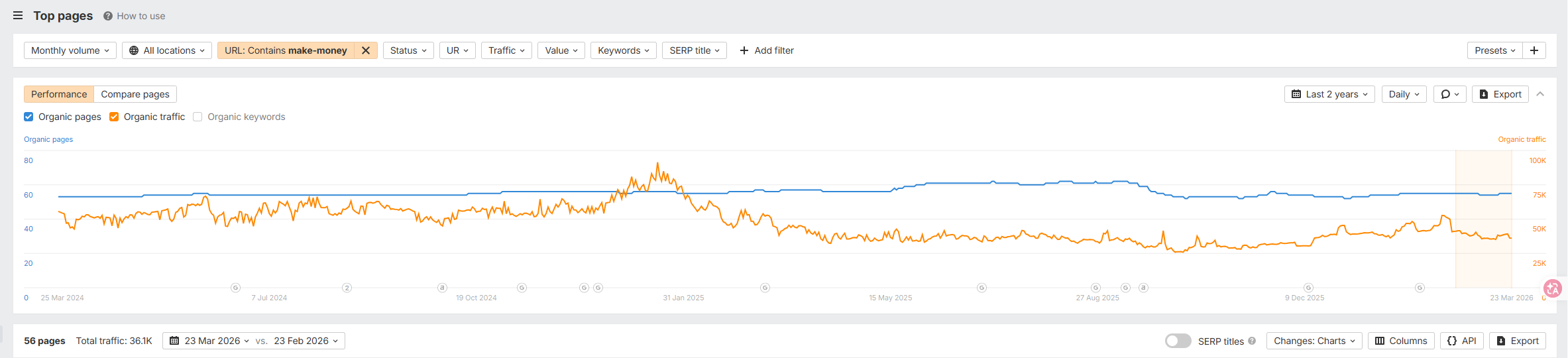

但这里有一个残酷的补充:pattern被识别后的惩罚力度,跟你的域名权威度成反比。 大站做同样的事,Google的容忍度更高。Wix(DR 93)在自己网站上铺了大量”make money”类的listicle内容,从2025年中开始流量明显下滑,但没有断崖式崩盘,至今还有几万的月流量在撑着,原因之一除了产出他们还有在不断优化更新。换一个DR 20的新站做一模一样的操作,早就被清零了。

所以问题不是”TL;DR该不该写”或者”FAQ该不该加”,而是你做的每一个动作,是出于对用户的真实价值,还是出于对搜索引擎的讨好?如果是后者,迟早会变成一个被识别的pattern,然后失效。

我观察英文SEO圈头部的从业者,发现一个很明显的趋势:他们不再频繁地在自己网站上产内容了。

Lars Lofgren做过affiliate内容站做到年收入720万美金,后来在HCU和算法更新中被打掉,现在转型做Fractional VP of Content,帮Perplexity、Automattic这种已经有品牌基础的公司做内容策略。David Quaid主要在X上输出短观点高频互动。Gagan Ghotra在Search Engine Land写专栏、上播客。

他们的网站更像是一个锚点,不是内容工厂。真正的影响力建设发生在网站之外——播客、社交媒体、行业对谈、第三方平台。每一次外部露出都是一次真实的entity信号积累,比在自己网站上写十篇自荐listicle有用得多。

他们在讨论entity、domain authority、brand signals、LLM visibility、谷歌算法造成的影响、为什么,以及猜测,写自己原创的实验数据。

我的判断

写一篇”best X”没问题。但写之前想清楚三件事:

第一,你列的东西经得起交叉验证吗?LLM会拿你的推荐去跟其他来源比对,如果你的排序跟行业共识矛盾,你得到的不是零信号,是负面信号。

第二,你有没有真实依据?有测试数据、有使用经验、有可验证的方法论,那这篇内容就是有价值的。如果只是为了把自己排第一随便凑的,那就别写——不写好过写错。

第三,你的时间花在哪里回报更高?写十篇自荐listicle,不如让一个真实的第三方在他的内容里提你一次。

搜索引擎在进化,Knowledge Graph在进化,LLM在进化,但它们判断信任的底层逻辑从来没变过:别人说你好,比你自己说自己好,永远更可信。

如果你的品牌从互联网上消失,会不会有信息损失?

如果会,你就有价值。如果不会,写一万篇”best X”也只是噪音。